SpecAugment: A Simple Data Augmentation Method

in projects / Jekyll on Blog, Github, Pages, Jekyll, Spacy

[논문] SpecAugment: A Simple Data Augmentation Method for Automatic Speech Recognition

음성인식 모델 관련 논문을 찾아보면 SpecAugment가 대부분 사용되는 것을 볼 수 있다

SpecAugment 논문에 어떤 기법들이 제시되어 있는지 알아본다.

1. Introduction

본 논문은 Augmenttation을 위한 3가지 기법을 소개한다.

- Time Warping 일정한 기준을 가지고 하나의 지점을 다른 지점으로 밀어버린다 밀어버린 결과 한쪽은 늘어나고 다른 한쪽은 줄어들은 형태가 나온다

- Frequency Masking

- Time Masking

2. Augmentation Policy

- Time Warping 워핑은 주로 이미지에서 사용되며 Tensorflow에도 sparse_image_warp로 구현되어 있다.

이미지 워핑은 쉽게 말해 이미지를 아래와 같이 찌그러트리는 기술이다.

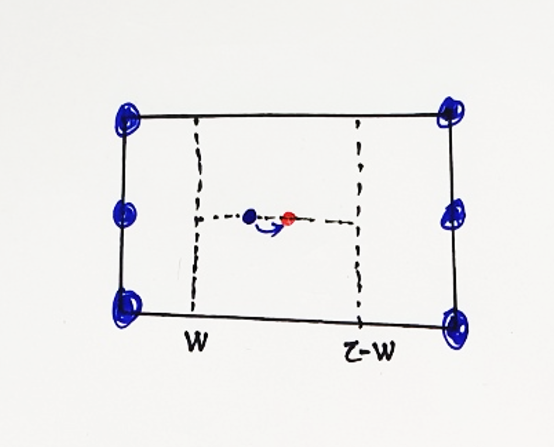

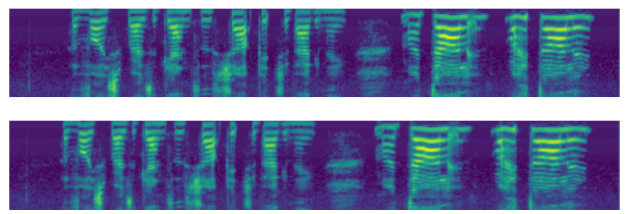

다음 그림은 이러한 워핑 기술을 mel-spectrogram 음성신호에 적용한 것이다.

time warping은 신호에서 하나의 점을 기준으로 잡고 그 점을 오른쪽 혹은 왼쪽으로 밀어주는 과정이다.

상세한 과정은 다음과 같다.

- 파란색으로 칠해진 여섯 지점을 고정시킨다

- [W, τ-W] 사이의 임의의 점 하나를 선택한다 (이미지 중앙의 수평선 위에 위차하는 점)

- [0,W] 사이의 선택된 값만큼 오른쪽 혹은 왼쪽으로 밀어준다

p 라는 파라미터를 두어

[참고] https://www.notion.so/SpecAugment-A-Simple-Data-Augmentation-Method-for-Automatic-Speech-Recognition-ece0a0be49844c7c93ab4f0045ee1562 https://github.com/bobchennan/sparse_image_warp_pytorch

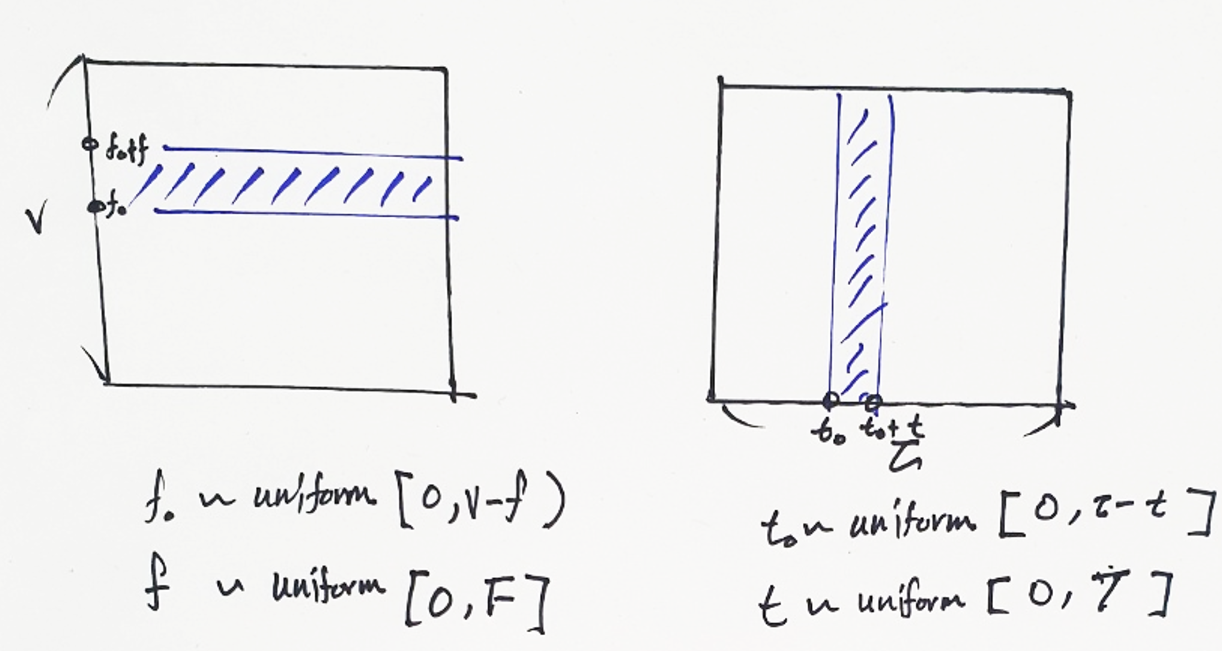

- Frequency / Time Masking

- [0, T] / [0,F]사이의 t, f 값 선택 (masking 폭 선정)

- [0, τ-t] / [0, v-f] 사이에서 $ t_0, f_0 $ 값 선택 (masking 위치 선정)

- $[t_0, t_0+t] / $[f_0, f_0+f]$ 사의 값들을 masking한다

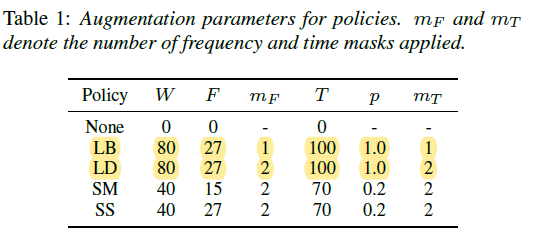

본 논문은 LibriSpeech에 다음과 같은 파라미터를 사용해 Augmentation을 적용해 본다

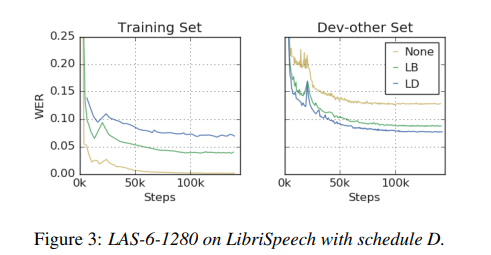

4. Experiment

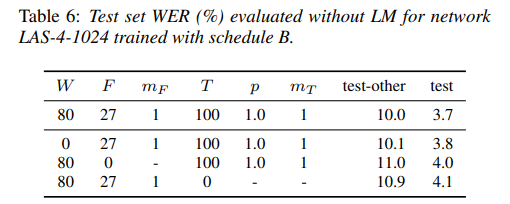

다음 표는 3가지 기법들 중 각각의 기법을 하지 않았을 경우의 WER을 보여준다.

- time warping : 3.8%

- frequency masking : 4.0%

- time masking : 4.1%

결과를 보면 알 수 있듯이 time warping은 성능에 어느정도 영향은 주지만 성능 향상의 주요한 요인은 아니다.

Time warping, being the most expensive as well as the least influential of the augmentations.

또한 본 논문에서는 이러한 Augmentation 기법들과 Label smoothing을 같이 사용하면 불안정한 학습이 진행될 수 있다고 한다. 특히 lr 이 감소되는 지점에서 더 크게 나타난다고 한다. 이것을 줄이고자 본 논문은 lr이 decay되는 지점에서는 label smoothing을 하지 않았다.